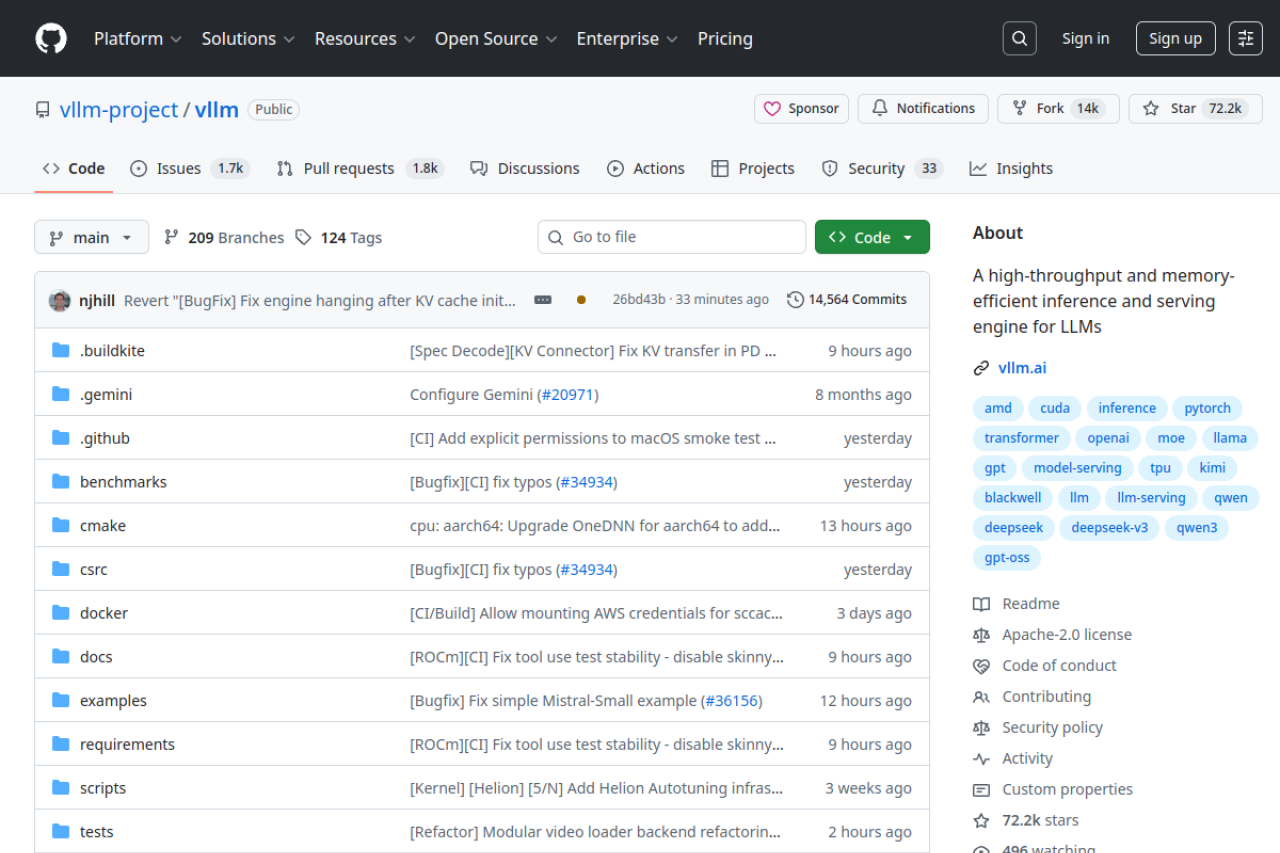

vLLM - 高吞吐量内存高效的大语言模型推理引擎

vLLM 是一个专为大语言模型(LLMs)设计的高性能推理和服务引擎,旨在解决大模型部署中的高延迟和内存占用过大问题。该项目通过先进的内存管理技术和优化算法,为企业和开发者提供了高效的LLM部署解决方案。

核心亮点

高吞吐量推理优化

vLLM 采用了创新的批处理和调度算法,能够显著提高大语言模型的推理吞吐量。通过智能的请求调度和资源分配,相比传统推理框架可以实现数倍的性能提升,特别适合需要处理大量并发请求的生产环境。

内存效率管理

该引擎实现了先进的内存管理机制,包括动态内存分配和KV缓存优化。通过PagedAttention等技术,vLLM能够大幅减少内存碎片,提高内存利用率,使得在有限的GPU内存下能够运行更大的模型或处理更多的并发请求。

易于集成部署

vLLM提供了简洁的API接口和完善的文档,支持多种主流大语言模型(如LLaMA、GPT系列等)。开发者可以轻松将现有模型迁移到vLLM平台,同时支持Docker容器化部署和云原生架构,降低了生产环境的部署复杂度。

适用场景

- 企业级AI服务:为需要高并发处理能力的企业级AI应用提供稳定可靠的推理服务

- 云服务提供商:帮助云平台优化GPU资源利用率,提供更经济高效的AI服务

- 研究机构:为AI研究人员提供高效的模型实验和评估平台,加速研究进程

获取方式

vLLM是开源项目,完全免费使用。用户可以直接从GitHub仓库克隆代码,按照官方文档进行安装配置。项目提供了详细的安装指南、API文档和使用示例,支持pip安装和源码编译两种方式。

相关推荐

- FastAPI:可与vLLM结合构建高性能的AI服务API

- Hugging Face Transformers:提供丰富的预训练模型资源,可直接在vLLM中使用

下载地址

最新版本 Release 安装包已上传至网盘,包含各平台版本(Windows/macOS/Linux/Android 等,视项目而定),可直接下载使用。

免责声明

本站内容主要用于信息整理、技术研究与经验分享,不对第三方产品或服务的可用性、完整性作出任何明示或暗示的保证。

- 本站所分享的资源、工具、教程等内容仅供学习与研究参考,请勿用于商业用途。

- 部分内容可能来源于公开网络或开源社区,如涉及版权或其他合法权益问题,请通过联系方式与我们联系,我们将在核实后及时处理。

- 如需将相关内容用于商业产品或盈利性业务,请自行联系权利方获取正式授权。

- 因不当使用引发的版权或合规风险,由使用者自行承担。

- 外部链接失效或无法访问属于正常现象,本站不保证所有链接的持续有效性。

转载或引用本文内容,请保留原文链接并注明来源。

评论

加载中...